La creciente influencia de la inteligencia artificial en el sector tecnológico ha llevado a la aparición de una práctica novedosa y controvertida conocida como «tokenmaxxing». Grandes compañías como Meta, OpenAI y startups tecnológicas de Silicon Valley están adoptando una nueva métrica intrigante que mide la productividad de sus empleados a través del consumo de tokens procesados por modelos de IA. Aunque vista como un avance en la adopción de tecnologías emergentes, esta práctica genera debates sobre su impacto real en los resultados organizacionales.

¿Qué es el tokenmaxxing?

El «tokenmaxxing» se basa en la maximización intencionada del consumo de tokens de modelos de inteligencia artificial como GPT-4, Claude o Llama. Según el sector, los tokens representan la unidad mínima de datos que procesan los modelos, y su utilización refleja el grado de automatización y delegación de tareas a estas herramientas avanzadas. Esta métrica ha causado revuelo, con algunos considerándola el nuevo estándar de productividad en entornos tecnológicos.

Meta, por ejemplo, emplea tableros internos de clasificación basados en el consumo de tokens por cada trabajador, generando una competencia implícita entre equipos. Un caso extremo, reportado en OpenAI, detalla cómo un ingeniero llegó a consumir 210 mil millones de tokens en una semana al operar múltiples agentes de IA, capaces de ejecutar tareas como programación, análisis de datos y generación autónoma de código de forma simultánea. No obstante, especialistas como Tomasz Tunguz han señalado que este enfoque podría tratarse simplemente de «convertir electricidad en trabajo útil».

Te puede interesar

Cambio en los beneficios: ¿Los tokens como nueva retribución laboral?

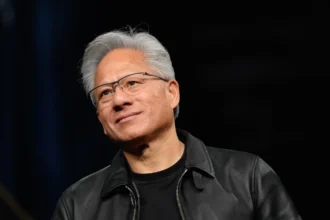

El tokenmaxxing no solo afecta las métricas de desempeño, sino también los beneficios laborales. Compañías líderes de Silicon Valley ya están incluyendo presupuestos para el uso de IA como parte de sus paquetes de compensación, asemejándolos a seguros médicos, bonos o acciones. Jensen Huang, CEO de NVIDIA, declaró que los tokens podrían ser reconocidos como el «cuarto pilar» de la retribución en la industria tecnológica.

En mercados europeos como Estocolmo, se registran situaciones en las que el coste mensual en herramientas de IA supera incluso los salarios netos de algunos empleados. Adoptando medidas similares, empresas como Shopify ya implementan tableros de consumo de tokens, mientras startups tecnológicas exploran cómo integrar esta nueva métrica en sus operaciones corporativas.

- Presupuestos de tokens en paquetes de beneficios.

- Costos operativos que rivalizan con salarios.

- Creciente adopción en startups globales.

Críticas y desafíos del tokenmaxxing en la productividad

El tokenmaxxing enfrenta críticas significativas relacionadas con su verdadera utilidad para evaluar productividad. Según Duncan Jones, esta práctica podría compararse a contar líneas de código en ciclos anteriores, es decir, una métrica que mide actividad en lugar de efectividad. Los críticos destacan que priorizar el consumo de tokens puede generar incentivos negativos, como recompensar la ineficiencia o incentivar estrategias que no reportan mejoras reales de negocio.

Este enfoque plantea desafíos organizacionales como la configuración ineficaz de agentes de IA que consumen más recursos de los necesarios, o la creación de métricas infladas que no reflejan la calidad del trabajo realizado. Además, expertos advierten que este modelo podría visibilizar inequidades entre costos de herramientas tecnológicas y su impacto en el talento humano, incentivando recortes laborales a favor de sistemas más automatizados.

- Premia la ineficiencia de procesos.

- Fomenta métricas manipulables sin impacto.

- Riesgo de recorte en personal humano.

Te puede interesar:

- SEC amplía fiscalización energética con inteligencia artificial para mejorar seguridad del mercado

- Acreditación minera digital IA: reduce hasta 95% de errores y acorta procesos de 40 días en faena